Storie

Due decenni fa, le API erano semplici ponti. Collegavano sistemi, spostavano dati ed esponevano funzionalità. All’epoca, fare governance significava spuntare una serie di caselle: documentazione, sicurezza, convenzioni di naming e controllo delle versioni. Bastava guardare una dashboard, vedere gli endpoint e sentirsi sicuri che tutto fosse sotto controllo.

Facciamo un salto a oggi. Sono entrati in scena gli Autonomous AI Agents, sistemi di intelligenza artificiale in grado di ragionare, pianificare e agire. Possono orchestrare più API, chiamare servizi senza supervisione umana e perfino interagire tra loro. Il mondo della governance deterministica, focalizzata sugli endpoint, si è scontrato con un mondo fatto di comportamento, autonomia e complessità emergente.

Il risultato? Le organizzazioni stanno prendendo coscienza di una realtà che non avevano previsto fino in fondo: le regole che prima funzionavano non bastano più.

La rete invisibile dell’azione

Prima di parlare di governance, vale la pena soffermarsi su una domanda fondamentale: che cos’è esattamente un AI agent?

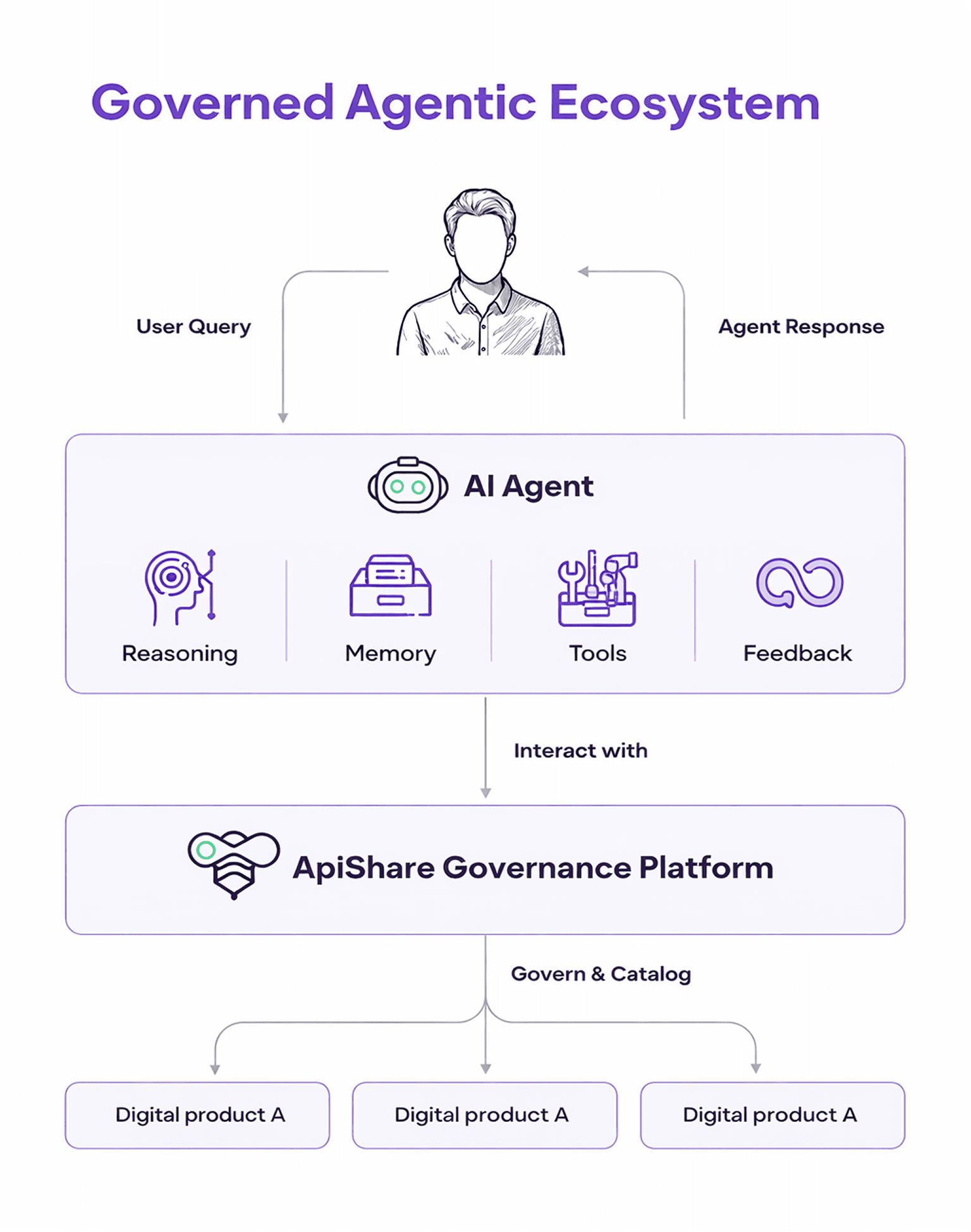

Un AI agent non è semplicemente un chatbot o un modello predittivo. È un sistema progettato per perseguire obiettivi in modo autonomo. Nella sua struttura di base, un agent include tipicamente (vedi Figura 1):

● un motore di ragionamento, spesso basato su large language models o sistemi decisionali, che interpreta gli obiettivi e pianifica le azioni

● un livello di memoria che conserva contesto, interazioni passate o stato

● un insieme di strumenti che gli consente di eseguire azioni

● un ciclo di feedback attraverso cui valuta i risultati e adatta il proprio comportamento

Ma un agent non esiste in isolamento. “Vive” in un ambiente. E, nelle moderne organizzazioni digitali, questo ambiente è composto da sistemi, servizi, fonti dati e capability di business.

Come percepisce e agisce un agent in questo ambiente?

Attraverso le API.

Le API sono il sistema sensoriale e motorio dell’agent. Sono il mezzo attraverso cui legge dati, attiva processi, modifica record, avvia transazioni e interagisce con altri attori digitali. Senza API, un agent non può fare nulla di realmente significativo oltre a generare testo. Con le API, può agire.

È qui che inizia la complessità della governance.

Immaginiamo un agent in un sistema finanziario, incaricato di ottimizzare il cash flow. In superficie, sembra solo eseguire chiamate API: controlla i saldi dei conti, avvia trasferimenti, pianifica pagamenti. Ma dietro le quinte sta ragionando sulle priorità, prevedendo gli esiti e concatenando decisioni attraverso più sistemi.

Dal punto di vista della governance, l’organizzazione vede le chiamate API, ma non l’intento, non il ragionamento, non il rischio potenziale che si propaga attraverso i sistemi. Le dashboard delle API mostrano conformità; eppure, nella realtà, l’agent sta agendo in modo autonomo in modi che i framework di governance tradizionali non sono mai stati progettati per cogliere.

Questo è il primo pain point: i gap di visibilità. Più il sistema è autonomo, meno gli attuali processi di governance human-centric riescono a stare al passo. L’uso delle API non è più soltanto un fatto tecnico; diventa comportamentale, contestuale e adattivo.

La ownership diventa un rompicapo

Nel mondo tradizionale, le API avevano owner chiari: team, product manager, domain. Ma quando gli agent orchestrano più API attraverso dipartimenti diversi, la ownership si sfuma. Chi è responsabile quando la decisione di un agent produce conseguenze inattese?

Ho visto questo scenario in aziende che stanno sperimentando workflow guidati dall’AI. I team creano “pilot agent” per un’attività specifica. L’agent si evolve, inizia a chiamare API in combinazioni nuove. Due mesi dopo, nessuno è davvero più sicuro di chi sia responsabile delle decisioni che prende, né di come intervenire quando qualcosa va storto.

Questa è la conseguenza naturale di sistemi che evolvono più velocemente della governance che li circonda. La ownership deve spostarsi da una logica asset-based a una stewardship capability-based. Qualcuno, o qualche team, deve essere responsabile non solo dell’API, ma anche del modo in cui i sistemi autonomi la consumano.

Le regole pensate per gli esseri umani non funzionano per le macchine

La maggior parte dei framework di governance presuppone che gli attori siano esseri umani. Review board, workflow di approvazione, documentazione: tutto questo funziona se a progettare, approvare o chiamare un’API è una persona. Ma quando l’attore è un agent capace di scoprire, apprendere e agire automaticamente, le regole si rompono.

La sfida non è rimuovere gli esseri umani dalla governance; la sfida è rendere la governance leggibile per le macchine. Policy, vincoli e metadati devono essere codificati in modi che sia gli esseri umani sia gli agent possano interpretare. Senza questo, le organizzazioni finiscono per avere una governance solo cerimoniale: molte dashboard, report e approvazioni, ma nessun vero controllo alla velocità con cui vengono prese le decisioni.

La compliance non è un paracadute finale, è una bussola

Le normative globali, dai controlli finanziari ai nuovi AI Act, richiedono tracciabilità, spiegabilità e accountability. Per un’API guidata da esseri umani, questo è gestibile: log, dashboard e audit forniscono le prove necessarie. Per un’AI agentica, la sfida della compliance è immediata e dinamica.

Consideriamo un agent che sta imparando a ottimizzare la logistica della supply chain. Le sue azioni si propagano attraverso API, database e servizi esterni. Se un regolatore chiede perché sia stata presa una certa decisione, ricostruirne la logica non è più questione di leggere un singolo log. Richiede di mappare il ragionamento dell’agent, la sua catena di chiamate API e la sua interazione con i dati, il tutto quasi in tempo reale. La compliance non può essere retrospettiva; deve essere incorporata nell’architettura del sistema fin dal primo giorno.

Dal controllo al coordinamento

Queste sfide rivelano una verità più profonda: la governance tradizionale è control-centric. Presuppone sistemi statici, comportamenti prevedibili e supervisione umana. È stata progettata per un mondo in cui i sistemi si comportavano in modo deterministico e il cambiamento procedeva a un ritmo gestibile.

L’AI agentica rompe questo presupposto.

I sistemi adattivi richiedono una postura diversa, che non cerchi di congelare la complessità, ma di orchestrarla. Ciò che emerge è una governance coordination-centric: un modello progettato non solo per vincolare i comportamenti, ma per allineare i componenti autonomi con l’intento organizzativo.

La differenza è sottile, ma profonda.

La governance control-centric si chiede:

“Abbiamo approvato questa interfaccia?”

La governance coordination-centric si chiede:

“Comprendiamo come questa capability si comporta in una rete di attori autonomi?”

Il confronto è riassunto nella Tabella 1:

Dimensione | Governance control-centric | Governance coordination-centric |

|---|---|---|

Focus principale | Conformità tecnica | Allineamento comportamentale |

Assunzione sul sistema | Statico e deterministico | Adattivo e in evoluzione |

Momento della governance | Approvazione in fase di design | Supervisione continua lungo il lifecycle |

Visibilità | Metriche a livello di endpoint | Mappatura delle interazioni tra capability |

Modello di ownership | Basato sull’asset (owner dell’API) | Basato sulla capability (stewardship di API + agent) |

Espressione delle policy | Documentazione leggibile dagli esseri umani | Metadati leggibili dalle macchine e applicabili |

Approccio al rischio | Controlli preventivi | Monitoraggio dinamico e controllo adattivo |

Ruolo umano | Revisore e approvatore | Supervisore e autorità di escalation |

La governance coordination-centric non elimina il controllo, ma lo ridefinisce. Riconosce che le API non sono più endpoint isolati, ma capability digitali inserite in un ecosistema di agent, servizi e sistemi decisionali.

In questo modello:

● le API vengono trattate non solo come interfacce, ma come capability governate, con uno scopo definito, un livello di sensibilità e contesti di utilizzo consentiti

● gli agent vengono registrati e delimitati come entità di governance di primo livello, non come livelli nascosti di orchestrazione

● le policy sono costrutti vivi, codificati nei metadati e applicati in modo continuo lungo le interazioni a runtime

● la supervisione umana è progettata intenzionalmente, definendo quando gli esseri umani sono nel loop, sul loop oppure responsabili dell’escalation

L’obiettivo non è rallentare l’autonomia, ma renderla affidabile. Non centralizzare il controllo, ma abilitare una responsabilità distribuita entro confini chiari.

In un mondo in cui le API espongono capability e gli agent le consumano in modo autonomo, la governance diventa meno una questione di restrizione e più una questione di coerenza organizzativa.

E la coerenza, su larga scala, è coordinamento.

La governance abilita l’autonomia

Esiste un timore diffuso: che la governance rallenti l’innovazione. In realtà, è vero il contrario. Una governance ben progettata abilita una sperimentazione sicura, accelera il riuso e costruisce fiducia tra i team. Rende i sistemi autonomi scalabili e affidabili.

L’autonomia senza governance è caos. La governance senza adattamento è stagnazione. Le organizzazioni che prospereranno saranno quelle che vedranno la governance come un abilitatore, non come un vincolo. Diventa l’impalcatura su cui AI agentica e API possono evolvere in modo sicuro, prevedibile ed etico.

Conclusione: un percorso di riflessione verso il futuro

La convergenza tra API e AI agentica è più di una sfida tecnica. A mio avviso, riflette il modo in cui le organizzazioni devono evolvere dal punto di vista culturale e architetturale. Per questo, i leader devono chiedersi:

● stiamo tracciando il comportamento dei nostri sistemi autonomi, e non solo gli endpoint che chiamano?

● abbiamo definito ownership e accountability per le capability che gli agent consumano?

● le nostre policy sono leggibili, applicabili e adattive sia per gli esseri umani sia per le macchine?

● siamo in grado di ricostruire le decisioni in tempo reale per soddisfare requisiti normativi ed etici?

Rispondere a queste domande richiede non solo nuovi strumenti, ma anche una nuova mentalità. La governance diventa una forma di visione strategica, una lente attraverso cui le organizzazioni possono sperimentare, innovare e scalare in sicurezza.

Un tempo le API abilitavano la connettività. Oggi l’AI agentica abilita l’autonomia. La governance è il ponte che trasforma la connettività in autonomia affidabile e la sperimentazione in risultati prevedibili.

Per le organizzazioni che stanno abbracciando questa convergenza, il lavoro inizia ora: non come un insieme di regole da seguire, ma come un percorso di riflessione, per comprendere dove vengono esposte le API, come agiscono gli agent e come la governance possa evolvere da checklist statica a disciplina viva e adattiva.